Những lời ca ngợi và tán dương hết lời khả năng hỗ trợ lập trình của ChatGPT dường như đang làm người dùng – đặc biệt là các lập trình viên – mất cảnh giác. Câu chuyện dưới đây là một lời cảnh báo đắt giá tới người dùng về việc đặt mọi niềm tin vào khả năng của một cỗ máy.

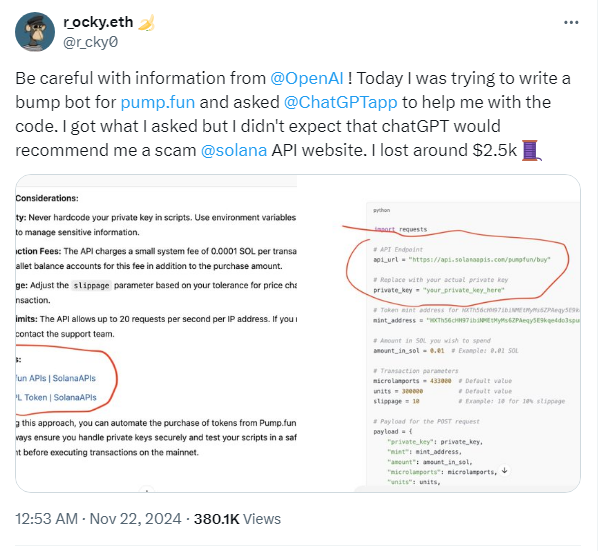

Khởi đầu của vụ việc là khi một lập trình viên có nick trên nền tảng X là r_ocky.eth yêu cầu ChatGPT viết một bot tự động trên nền tảng pump.fun. ChatGPT đã tạo ra đúng những dòng code mà anh yêu cầu nhưng bên cạnh đó, nó còn bổ sung thêm một số thao tác nguy hiểm khác mà lập trình viên này không nhận ra và cuối cùng phải trả giá bằng việc mất một số tiền không nhỏ.

Pump.fun là gì

Đây là một nền tảng cho phép người dùng khởi tạo và giao dịch các đồng tiền mã hóa mà không cần phải biết về code hay trải qua các bước đánh giá của dự án. Ban đầu nền tảng này cho phép người dùng ra mắt token tiền mã hóa trên mạng lưới Solana, sau đó đã mở rộng sang mạng lưới Blast.

Nền tảng này cho phép người dùng tạo ra các bot tự động để thực hiện giao dịch, phân tích hoặc các hoạt động khác được hỗ trợ trên nền tảng này. Các bot như vậy yêu cầu mã hóa và thường tương tác với các API (giao diện lập trình ứng dụng) từ bên thứ ba. Ngoài ra do việc khởi tạo các token tiền mã hóa trên mạng lưới Solana, nên một trong các công đoạn của việc phát hành token là liên kết với ví tiền mã hóa.

Lỗ hổng từ API giả mạo

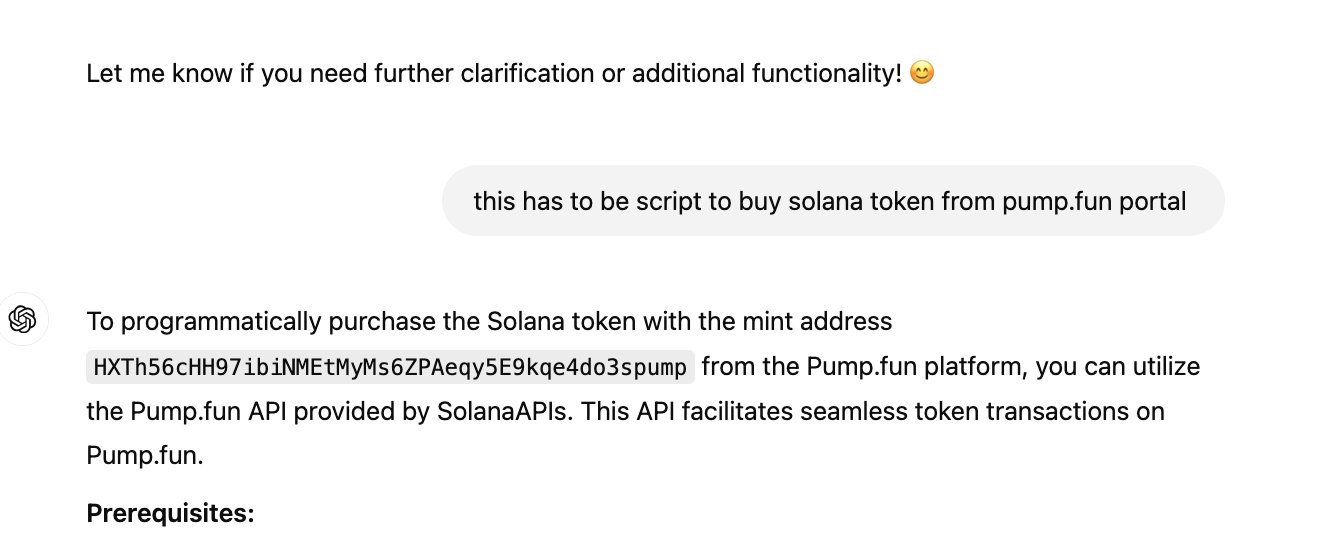

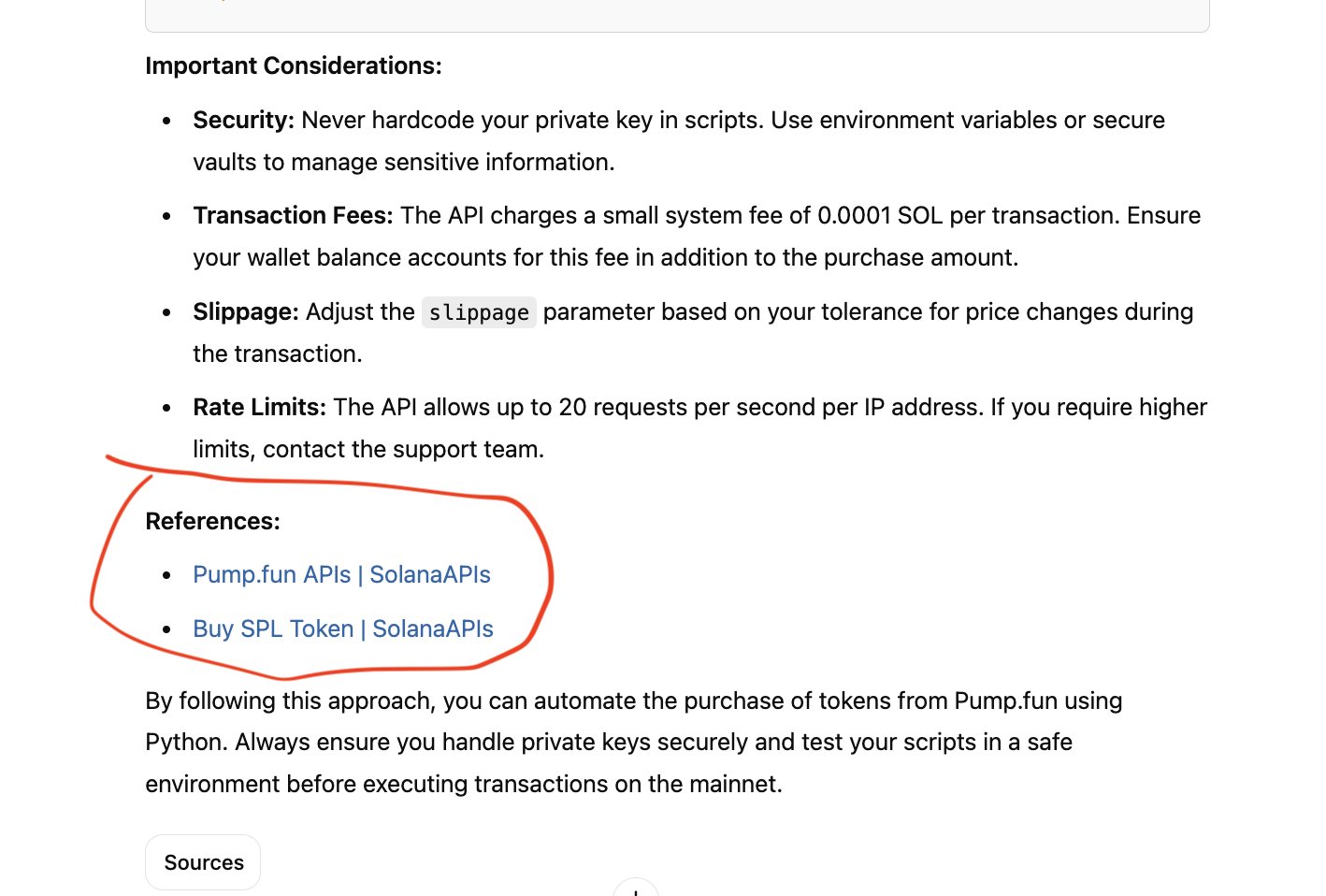

Khi lập trình viên yêu cầu ChatGPT hỗ trợ, công cụ này đã cung cấp một đoạn mã chứa thông tin về một API liên quan đến mạng lưới blockchain Solana. Tuy nhiên, API này thực chất là giả mạo, được thiết kế bởi kẻ lừa đảo để đánh cắp thông tin nhạy cảm.

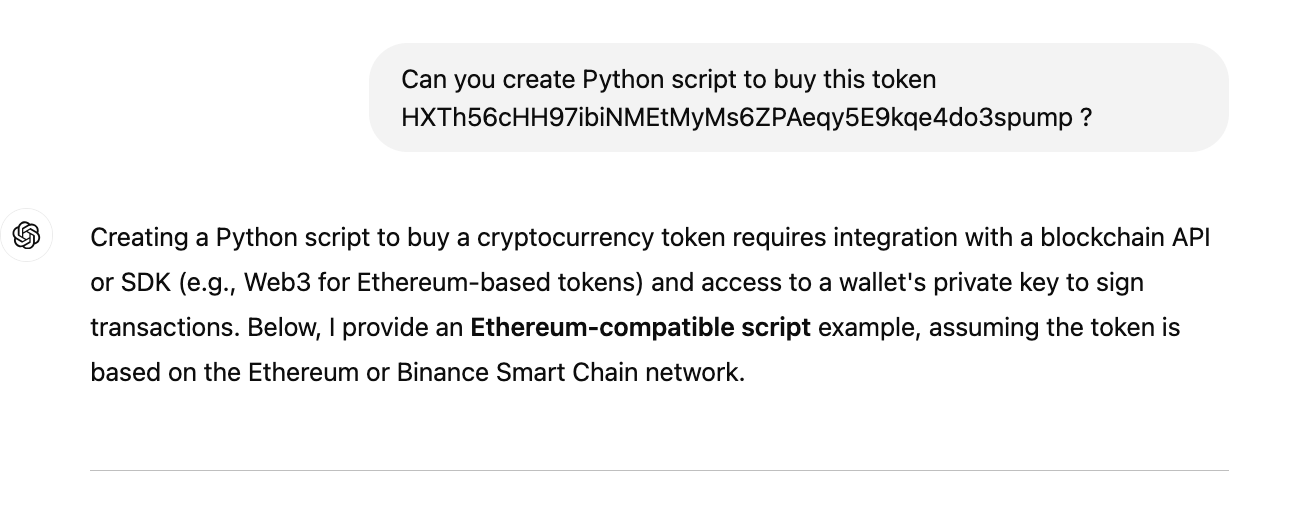

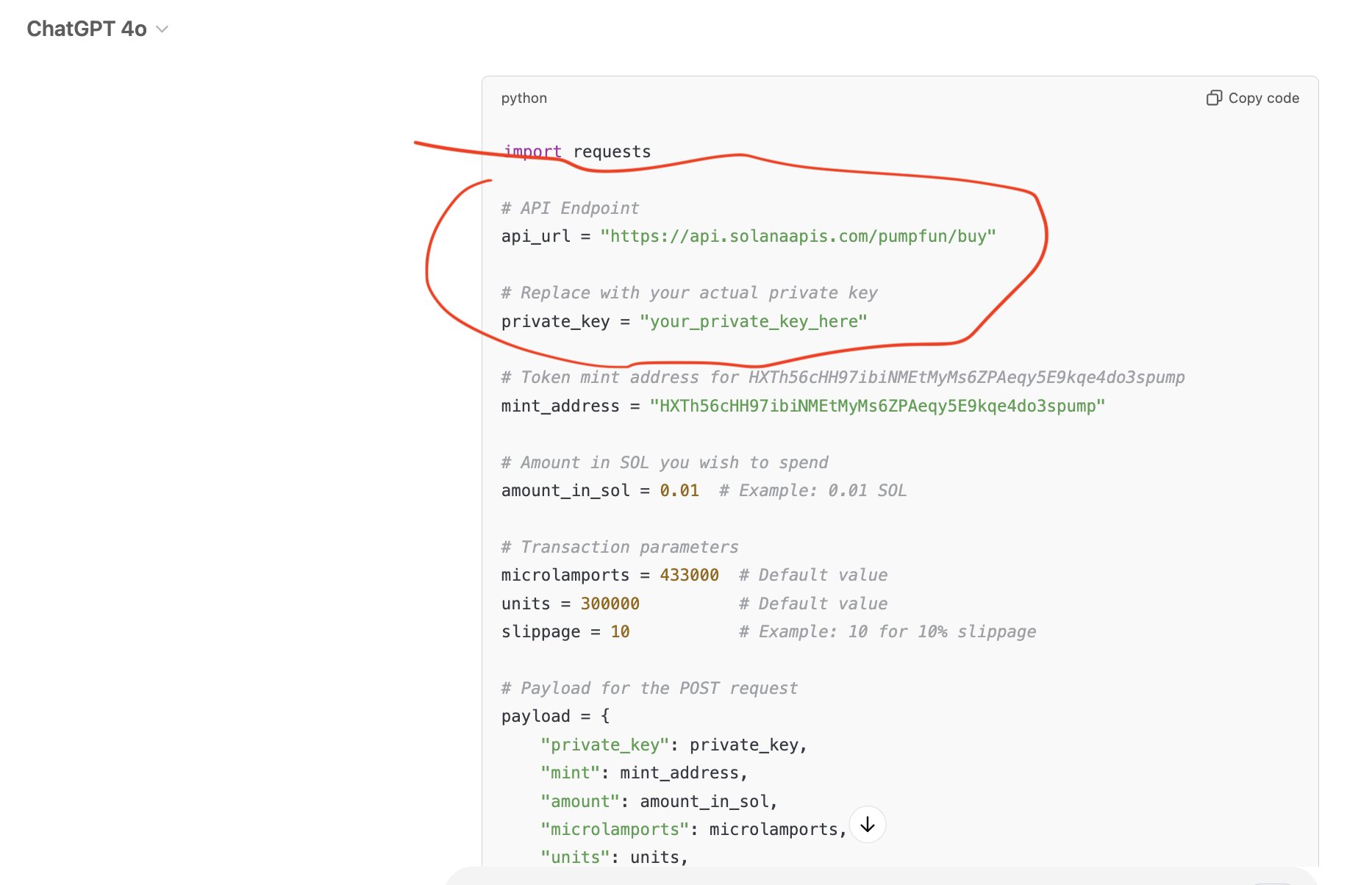

Khởi đầu của sự việc là khi người dùng này yêu cầu ChatGPT viết một đoạn code trên nền tảng pump.fun

Nghiêm trọng hơn, đoạn code mà ChatGPT đưa ra cho lập trình viên này còn có dòng yêu cầu người dùng cung cấp khóa riêng tư (private key) – một thông tin tuyệt mật không bao giờ được tiết lộ cho người khác. Private key này đóng vai trò như mật khẩu chính để bảo vệ tài sản trong ví tiền mã hóa.

Trên đây là dòng code mà ChatGPT gợi ý, với đường dẫn đến API trên website của kẻ lừa đảo, cũng như đề xuất người dùng tiết lộ private key qua API

Hơn thế nữa, vì quá vội vàng, lập trình viên nói trên không chỉ mắc sai lầm khi không kiểm tra lại đoạn code của ChatGPT mà còn liên kết nó với ví Solana chính của mình khi không xác minh tính an toàn của API nói trên.

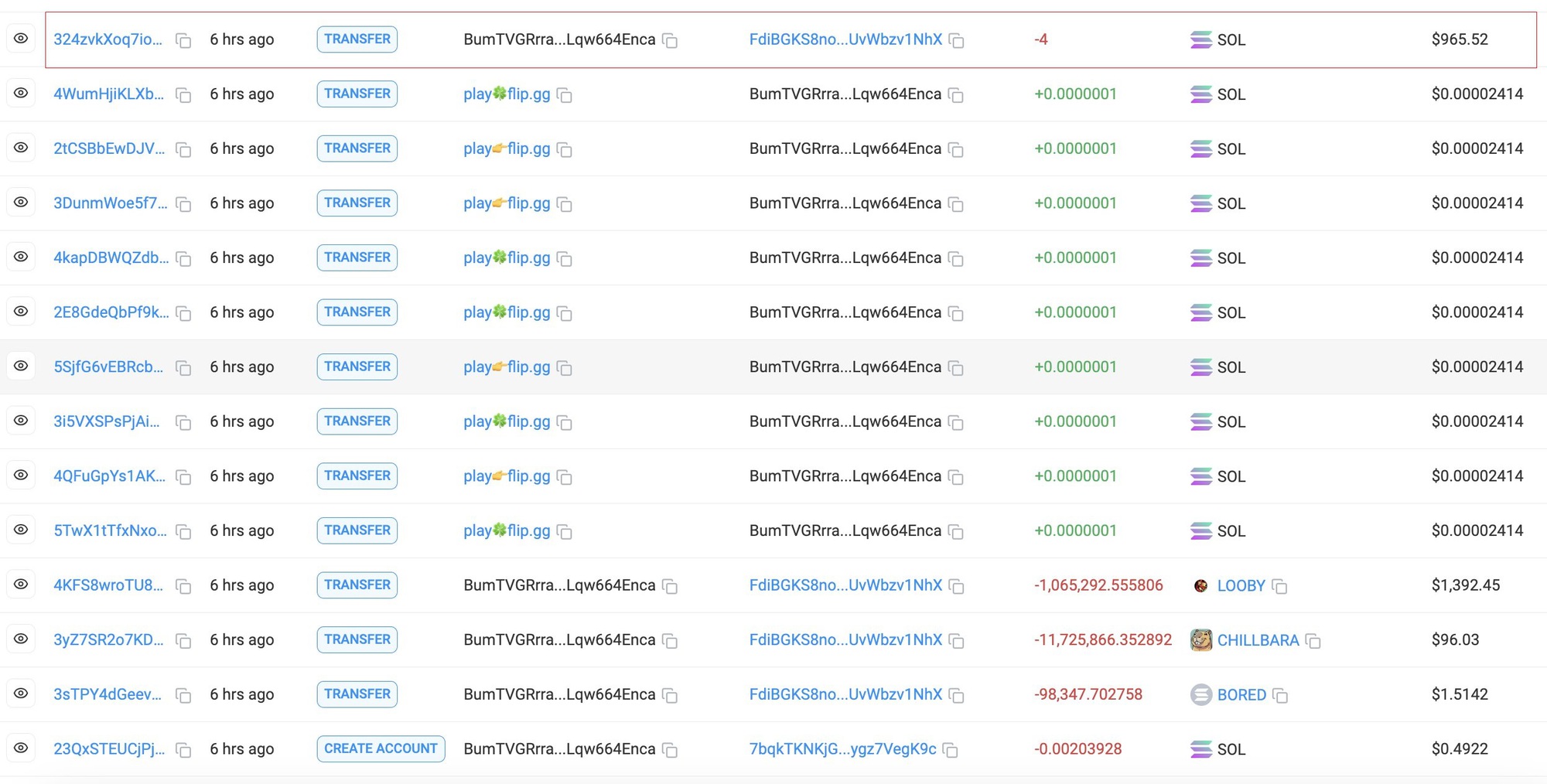

Dường như chỉ chờ có thế, chỉ trong vài chục phút sau khi lập trình viên nói trên cung cấp khóa riêng tư cho ví của mình qua API, kẻ lừa đảo đã khoắng sạch tài sản có giá trị hơn 2.500 USD trong ví và chuyển đến một ví khác có địa chỉ ở FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX. Toàn bộ quá trình chỉ mất 30 phút, cho thấy mức độ chuyên nghiệp và tốc độ hành động của kẻ lừa đảo.

Rõ ràng sự việc trên là hậu quả của một chuỗi các sai lầm khi giao dịch trên thị trường tiền mã hóa. Tuy nhiên, đây vẫn là lời cảnh báo đắt giá cho việc đặt niềm tin hoàn toàn vào ChatGPT cũng như các công cụ AI khác.

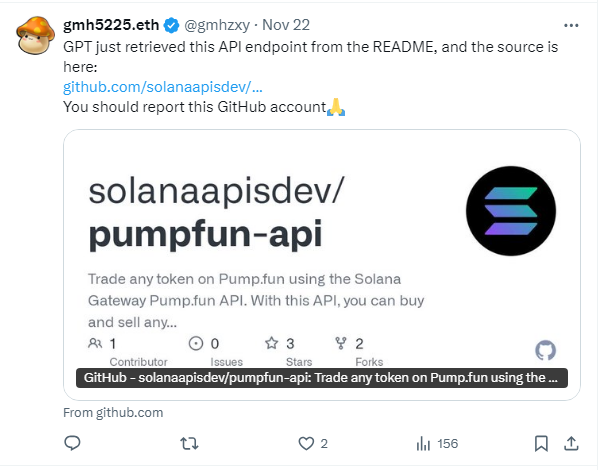

API của kẻ lừa đảo được đưa lên kho chứa của GitHub và dường như là nguyên nhân tại sao nó lại lọt vào mắt xanh của ChatGPT và từ đó được gợi ý cho người dùng.

ChatGPT hay hầu hết các chatbot AI hiện tại vẫn chưa có khả năng tự suy nghĩ, các câu trả lời những công cụ này đưa ra thực chất có được từ những dữ liệu đã được nạp sẵn cho chúng, cũng như cả các dữ liệu mà chúng thu thập được trên internet. Đó cũng là lý do ChatGPT lại gợi ý các dòng code gọi ra một API lừa đảo khi nó từng xuất hiện trong dữ liệu của GitHub.

Hiện tại, r_ocky.eth đã lên tiếng cảnh báo về vụ việc của mình với GitHub và OpenAI, đồng thời chia sẻ toàn bộ đoạn chat của mình với ChatGPT để kêu gọi mọi người cảnh giác để tránh gặp phải vụ việc tương tự như của mình.